Il Pentagono ha usato Claude di Anthropic per guidare l’attacco in Iran

L'integrazione dell'IA nei conflitti segna il passaggio definitivo alla cosiddetta Hyper Warfare

Le forze militari statunitensi hanno utilizzato il modello di intelligenza artificiale Claude, sviluppato da Anthropic, per coordinare i recenti attacchi aerei contro obiettivi strategici in Iran. La notizia, rivelata dal Wall Street Journal, è arrivata appena poche ore dopo che il Presidente Donald Trump aveva ordinato a tutte le agenzie federali di cessare immediatamente ogni collaborazione con la società fondata e guidata da Dario Amodei. Il Pentagono, pur avendo ricevuto l'ordine di eliminare gradualmente l'IA di Anthropic entro sei mesi, ha ritenuto lo strumento indispensabile per il successo dell'operazione.

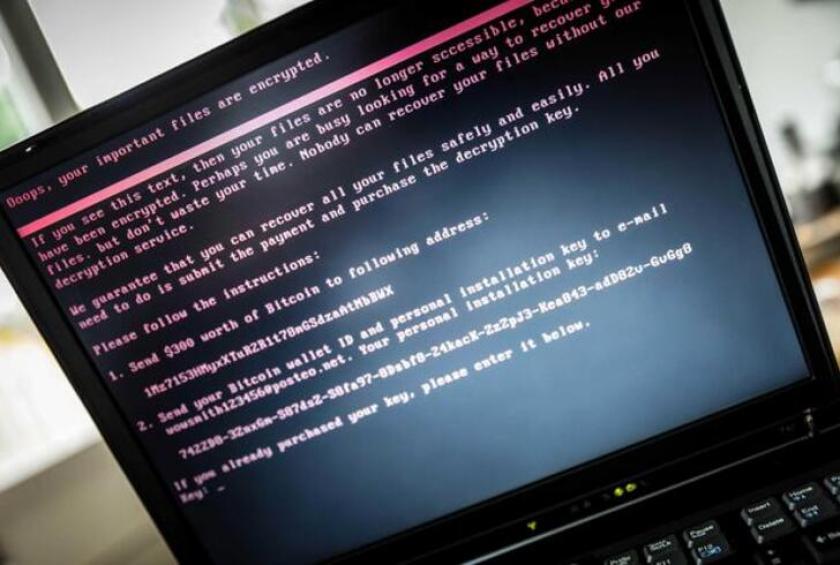

Così Claude ha guidato i raid

Secondo fonti vicine al Comando Centrale degli Stati Uniti (CENTCOM), il sistema Claude è stato integrato nei flussi di lavoro classificati per compiti di estrema precisione. Nello specifico, l'IA è stata impiegata per la fusione dell'intelligence, ovvero l'analisi simultanea di enormi moli di dati provenienti da droni, satelliti e intercettazioni, accelerando drasticamente l'identificazione dei target. Claude ha inoltre permesso di generare simulazioni in tempo reale dei possibili scenari di combattimento, prevedendo le reazioni delle difese aeree iraniane e ottimizzando le rotte dei missili. Non è la prima volta che questa tecnologia si rivela cruciale. Rapporti recenti indicano che il medesimo sistema era stato fondamentale a gennaio per l'analisi dei dati che ha portato alla cattura del leader venezuelano Nicolás Maduro.

Lo scontro tra Washington e Anthropic

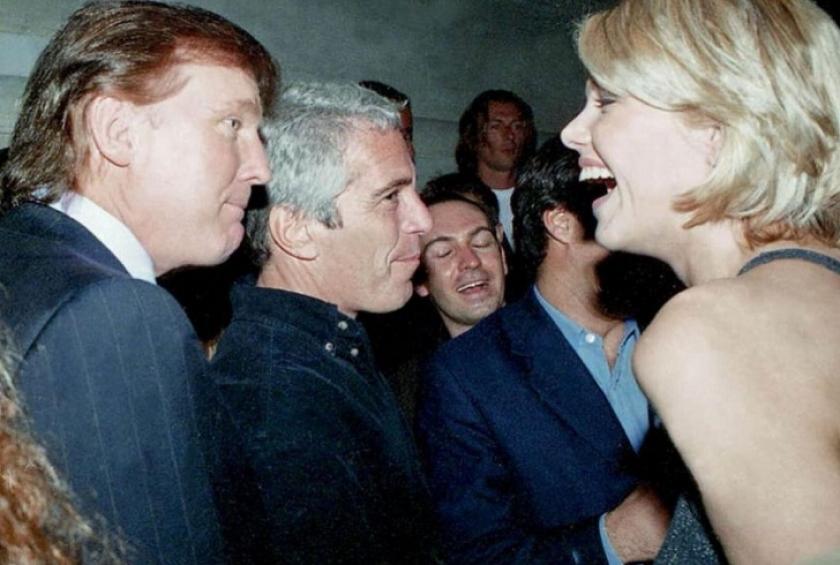

Alla base del conflitto tra l'amministrazione americana e l'azienda guidata da Dario Amodei vi è una divergenza etica inconciliabile. Il Segretario della Difesa, Pete Hegseth, aveva presentato un ultimatum ad Anthropic chiedendo un accesso "senza vincoli" ai modelli per fini bellici. Anthropic ha però opposto un netto rifiuto, tracciando due invalicabili "linee rosse": il divieto di utilizzare l'IA per la sorveglianza di massa dei cittadini e l'opposizione allo sviluppo di armi letali completamente autonome. Questa resistenza è stata interpretata da Trump come un atto di "arroganza woke" e una minaccia alla sicurezza nazionale, portando alla designazione di Anthropic come "rischio per la catena di approvvigionamento" (supply chain risk), un'etichetta solitamente riservata ad aziende di nazioni nemiche come la Cina.

La metamorfosi della guerra nell'era dell'IA

L'integrazione massiccia dell'IA nei conflitti moderni segna il passaggio definitivo alla cosiddetta Hyper Warfare, una forma di guerra in cui la velocità delle decisioni algoritmiche può superare la capacità di comprensione e reazione umana. Trasformare l’atto bellico in un processo computazionale gestito dall’intelligenza artificiale comporta due rischi principali. Il primo è l’indebolimento della responsabilità morale e politica nelle scelte compiute. Il secondo è l’aumento della possibilità di escalation rapide e difficili da controllare, in cui il margine di intervento di un comandante umano si riduce drasticamente.

Commenta per primo.